La lingua dei segni tradotta in inglese: un nuovo progetto

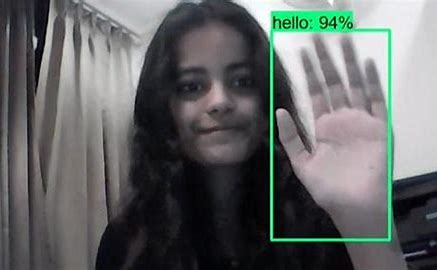

Se la cultura e l’arte oggi parlano un linguaggio di innovazione anche tecnologica, dobbiamo dare voce a quei progetti che guardano con soluzioni innovative il tema dell’inclusività. Un nuovo pionieristico progetto – ancora in fase sperimentale – ci anticipa una strada percorribile nel breve tempo: una giovane studentessa di ingegneria, Priyanjali Gupta, ha infatti messo a punto un modello di intelligenza artificiale che traduce immediatamente la lingua dei segni americana (ASL) in inglese.

Priyanjali Gupta

Priyanjali Gupta è una studentessa al terzo anno del Vellore Institute of Technology, Tamil Nadu, e sta attualmente conseguendo la sua laurea in ingegneria – specializzandosi in data science. La madre di Priyanjali è docente all’Università di Delhi e suo padre lavora allo Spice Jet.

In un post su LinkedIn, Priyanjali ha dichiarato: “Realizzato questo modello utilizzando questa super ‘Tensorflow object detection API. Il modello traduce alcuni segni ASL in inglese utilizzando l’apprendimento del trasferimento dal modello ssd_mobilenet preaddestrato”

Il post originale

Nel post originale su LinkedIn, Priyanjali Gupta ha aggiunto anche il codice. “Made this model using this cool Tensorflow object detection api.🙈 The model translates a few ASL signs to English using transfer learning from pretrained ssd_mobilenet model. You can checkout the code in the following link https://lnkd.in/eRFH4x6A

Il post su LinkedIn di Priyanjali Gupta è diventato virale con 65.000 like. In un’intervista a Interesting Engineering Priyanjali ha raccontato che nel 2021 sua madre l’aveva spronata a “creare” qualcosa, visto che seguiva un corso in ingegneria e durante alcune conversazioni con Alexa le era venuto in mente di lavorare ad una una tecnologia inclusiva. E così Gupta ha creato un modello di intelligenza artificiale che sfrutta l’API Tensorflow di rilevamento degli oggetti. Sempre su Interesting Engineering Gupta racconta che la sua ispirazione al modello viene dal video di Nicholas Renotte sul rilevamento della lingua dei segni in tempo reale.

5%

Quante sono le persone sorde (e con problemi di udito) nel mondo? Secondo l’Organizzazione Mondiale della Sanità (OMS ), oltre il 5% della popolazione mondiale soffre di ipoacusia invalidante. Il cinque percento può sembrare un numero esiguo, ma si tratta di oltre 460 milioni di persone in tutto il mondo. In molti si stanno muovendo nella direzione di nuovi modelli di rilevamento della lingua dei segni – ricordiamo ad esempio i ricercatori di Google AI. In questa direzione l’Intelligenza Artificiale potrebbe essere l’alleato vincente nella creazione di programmi di traduzione simultanea della lingua dei segni.

Perchè un articolo sull’IA e lingua dei segni su Notiziarte?

Non ci stancheremo mai di sottolineare che Cultura chiama Inclusione – la cultura è per tutti. L’art. 6 del Codice dei Beni Culturali e del Paesaggio (D.Lgs 42/2004) ribadisce che la valorizzazione del patrimonio culturale consiste anche nel “ […] assicurare le migliori condizioni di utilizzazione e fruizione pubblica del patrimonio stesso, anche da parte delle persone diversamente abili al fine di promuovere lo sviluppo della cultura […]”. Per questo motivo anche tutte le istituzioni culturali sono chiamate a seguire le evoluzioni tecnologiche e ad aggiornarsi con le nuove strumentazioni che in un futuro potranno permettere una fruizione pubblica sempre più inclusiva.